เฉลิมชัย วงษ์เกตุ

Chief Security Service and Innovation Officer

Security Pitch Co.,Ltd.

คงไม่มีผู้ใดปฏิเสธว่า ปัญญาประดิษฐ์ (Artificial Intelligence: AI) ได้กลายเป็นพลังขับเคลื่อนหลักของเศรษฐกิจและสังคมทั่วโลก สำหรับประเทศไทย รัฐบาลได้ให้ความสำคัญกับการพัฒนา AI อย่างต่อเนื่อง สะท้อนจากนโยบายและยุทธศาสตร์ชาติที่มุ่งผลักดันให้ AI เป็นเครื่องมือสำคัญในการยกระดับขีดความสามารถในการแข่งขันของประเทศในเวทีโลก

ยิ่ง AI มีบทบาทสำคัญและเป็นส่วนหนึ่งของความก้าวหน้าที่ขับเคลื่อนประเทศมากเท่าใด ประเด็นท้าทายในหลายมิติก็ยิ่งเพิ่มขึ้นตามไปด้วย โดยเฉพาะอย่างยิ่งในมิติของการคุ้มครองข้อมูลส่วนบุคคล ซึ่งเป็นปัจจัยพื้นฐานที่ AI ต้องพึ่งพาอย่างหลีกเลี่ยงไม่ได้ การบังคับใช้พระราชบัญญัติคุ้มครองข้อมูลส่วนบุคคล พ.ศ. ๒๕๖๒ ในบริบทของ AI ยังคงเผชิญความท้าทายหลายประการ ไม่ว่าจะเป็นการตีความขอบเขตการเก็บรวบรวมและประมวลผลข้อมูล ความโปร่งใสของอัลกอริทึม ตลอดจนสิทธิของเจ้าของข้อมูลในกระบวนการตัดสินใจอัตโนมัติ ความท้าทายดังกล่าวส่งสัญญาณชัดเจนว่า ประเทศไทยต้องการมากกว่าแค่กฎหมาย แต่จำเป็นต้องมีการประกาศมาตรฐาน แนวปฏิบัติ และกลไกที่ส่งเสริม สนับสนุน และลดข้อจำกัดในการพัฒนาและใช้งาน AI อย่างสมดุลระหว่างนวัตกรรมและการคุ้มครองสิทธิของประชาชน

บริษัท ซีเคียวริตี้ พิทช์ จำกัด ในฐานะภาคเอกชนที่ดำเนินธุรกิจหลักด้าน AI และมีความเชี่ยวชาญในการผสานเทคโนโลยีด้าน Safety เข้ากับ Security และ Privacy เชื่อมั่นว่า หากประเทศไทยสามารถพัฒนากลไกที่ทำให้ข้อมูลส่วนบุคคลถูกนำมาใช้อย่างมั่นคงปลอดภัย จะเกิดการพัฒนาอย่างก้าวกระโดดในหลากหลายมิติ โดยเฉพาะด้านการแพทย์ การศึกษา และการให้บริการสาธารณะ เป็นต้น แต่ประเทศไทยจะไปถึงจุดนั้นได้อย่างไร เพราะปัญหาที่เกิดขึ้นจริงในปัจจุบันคือ เมื่อองค์กรนำAI มาใช้งาน ไม่ว่าจะเป็น Foundation Models, Generative AI, ระบบวิเคราะห์ข้อมูล หรือ AI ประมวลผลภาพวิดีโอ ข้อมูลส่วนบุคคลของประชาชนมักถูกส่งเข้าสู่ระบบ AI โดยตรงและขาดกลไกตรวจสอบกลั่นกรองที่เพียงพอ ความเสี่ยงจึงเกิดขึ้นได้ทุกจุด ตั้งแต่การที่พนักงานป้อนชื่อ-นามสกุลหรือเลขบัตรประชาชนลงใน Chatbot ไปจนถึงกล้องวงจรปิดที่ส่งภาพใบหน้าประชาชนเข้าสู่ระบบ AI วิเคราะห์โดยปราศจากการปกป้องใด ๆ

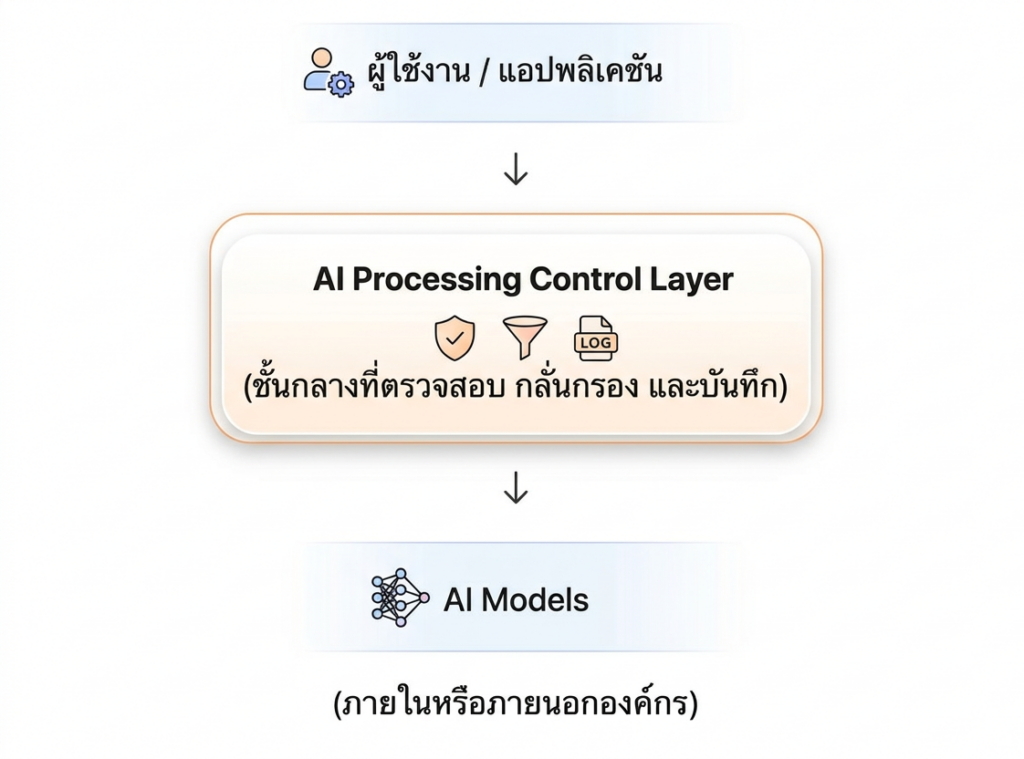

ซีเคียวริตี้ พิทช์ มองว่าทุกปัญหาคือโอกาสในการคิดค้นแนวทางแก้ไข และมองว่าข้อจำกัดที่กล่าวมาข้างต้น สามารถแก้ไขได้ด้วยการมีสถาปัตยกรรม จึงเสนอแนวคิด AI Processing Control Architecture (PCA) ซึ่งเป็นสถาปัตยกรรมการควบคุมที่ทำหน้าที่เป็น “ชั้นกลาง” หรือ Control Layer ระหว่างผู้ใช้งานกับโมเดล AI ทุกตัว แนวคิดนี้ตอบคำถามสำคัญที่ว่า เราจะทำให้ AI ทำงานได้อย่างเต็มประสิทธิภาพโดยที่ข้อมูลส่วนบุคคลไม่รั่วไหลได้อย่างไร

หลักการพื้นฐานและโครงสร้างของ AI Processing Control Architecture ยึดหลักการสำคัญ 5 ประการ ได้แก่

(1) Privacy by Design การออกแบบระบบที่ปกป้องข้อมูลตั้งแต่ต้น

(2) Data Minimization การลดรูปข้อมูลส่วนบุคคลก่อนเข้าสู่ AI

(3) Controlled AI Processing การส่งข้อมูลผ่าน Control Layer เสมอ

(4) Accountability ความสามารถในการตรวจสอบย้อนหลัง

(5) Model Independence ไม่ผูกขาดกับ AI vendor รายใดรายหนึ่ง

โดยมีโครงสร้างการทำงานดังนี้

จากผังข้างต้น ชั้นกลางนี้คือหัวใจของสถาปัตยกรรม ทำหน้าที่ตรวจสอบข้อมูลก่อนส่งเข้า AI ป้องกันการรั่วไหลของข้อมูลส่วนบุคคล (PII Leakage) ควบคุมการเข้าถึง AI บันทึกการใช้งานทุกครั้ง และตรวจสอบผลลัพธ์ของ AI ก่อนส่งคืนผู้ใช้งาน โดย AI Processing Control Layer ต้องมีความสามารถสำคัญอย่างน้อย 5 ด้าน คือ

1. Data Inspection Engine

ระบบต้องตรวจจับข้อมูลส่วนบุคคลอัตโนมัติก่อนส่งเข้า AI อย่างน้อย เช่น ชื่อ-นามสกุล หมายเลขโทรศัพท์ เลขประจำตัวประชาชน ข้อมูลไบโอเมตริก ข้อมูลสุขภาพ ข้อมูลการเงิน และข้อมูลความลับทางธุรกิจ เป็นต้น

2. Data Masking/Redaction

เมื่อพบข้อมูลส่วนบุคคล ระบบต้องสามารถปิดบัง แก้ไข ตัดทอน หรือแยกข้อมูลเป็นส่วนย่อย (Tokenize) ก่อนส่งต่อ

3. AI Interaction Logging

ระบบต้องบันทึกทุกการโต้ตอบระหว่างผู้ใช้กับ AI ได้แก่ คำสั่ง (Prompt) การตอบสนองของ AI ข้อมูลระบุตัวตนผู้ใช้ โมเดลที่ใช้ วันเวลา และระดับการจัดชั้นข้อมูล เพื่อให้ตรวจสอบย้อนหลังได้ตามกฎหมาย

4. Third-Party AI Data Transfer Control

กรณีใช้ AI จากภายนอก ต้องมีระบบควบคุมการส่งข้อมูลออก กรองข้อมูลขาออก และจัดระดับความเสี่ยง

5. Output Inspection

ผลลัพธ์ของ AI ต้องถูกตรวจสอบก่อนส่งถึงผู้ใช้ เพื่อตรวจจับข้อมูลส่วนบุคคลที่อาจรั่วไหล รวมถึงข้อมูลอ่อนไหวที่ AI อาจสร้างขึ้นจากการ Hallucination

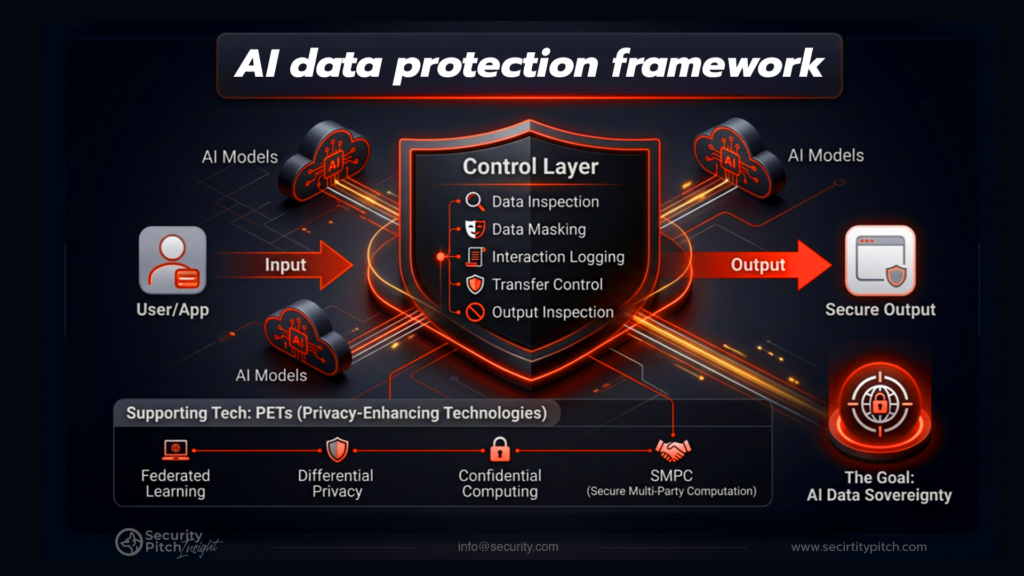

เมื่อได้ออกแบบสถาปัตยกรรมมาอย่างครบถ้วนแล้ว ลำดับต่อไปก็คือการเลือกใช้เทคโนโลยี ที่สามารถทำงานได้ตามสถาปัตยกรรมที่ออกแบบนั้น ซึ่งปัจจุบัน Privacy-Enhancing Technologies (PETs) คือคำตอบ

เพื่อให้ AI Processing Control Architecture มีประสิทธิภาพสูงสุด จำเป็นต้องบูรณาการ Privacy-Enhancing Technologies (PETs) เข้าไปในทุกชั้นของสถาปัตยกรรม โดย PETs ประกอบด้วย

1. Federated Learning

ที่ให้ AI เรียนรู้จากข้อมูลภายในองค์กรโดยไม่ต้องส่งข้อมูลดิบออกมารวมศูนย์

2. Differential Privacy ที่เพิ่มสัญญาณรบกวนทางคณิตศาสตร์เพื่อป้องกันการระบุตัวบุคคลจาก dataset และ

3. Confidential Computing

ที่ใช้ Trusted Execution Environment (TEE) ให้ AI ประมวลผลข้อมูลอ่อนไหวโดยไม่เปิดเผยข้อมูลจริง

4. Secure Multi-Party Computation (SMPC) ที่รองรับการประมวลผลข้อมูลจากหลายองค์กรร่วมกัน เช่น การวิเคราะห์ข้อมูลสุขภาพข้ามโรงพยาบาลหรือการตรวจจับการทุจริตทางการเงิน

และอีกเรื่องหนึ่งสะท้อนความสำคัญอย่างเด่นชัดโดยเฉพาะในช่วงที่โลกกำลังเผชิญหน้ากับเหตุสงครามซึ่งมีการใช้กล้องโทรทัศน์วงจรปิดเป็นเครื่องมือ คือ เรื่อง AI Video Processing Control ในบริบทของความไม่มั่นคงปลอดภัยของระบบกล้องโทรทัศน์วงจรปิดซึ่งเป็นภัยคุกคามที่ทวีความรุนแรงในสถานการณ์โลกปัจจุบัน AI Processing Control Architecture ได้กำหนด Video Privacy Control Layer เพิ่มเติมสำหรับ AI ที่ประมวลผลวิดีโอโดยเฉพาะ ระบบต้องสามารถตรวจจับใบหน้า ป้ายทะเบียน และบุคคลที่ระบุตัวตนได้ จากนั้นดำเนินการปิดบัง (Blur/Mask/Anonymize) ข้อมูลเหล่านั้นก่อนส่งเข้า AI Analytics พร้อมทั้งแยก Identity Layer กับ Behavior Layer ออกจากกัน เพื่อให้ AI วิเคราะห์พฤติกรรมได้โดยไม่จำเป็นต้องรู้ว่าบุคคลนั้นคือใคร

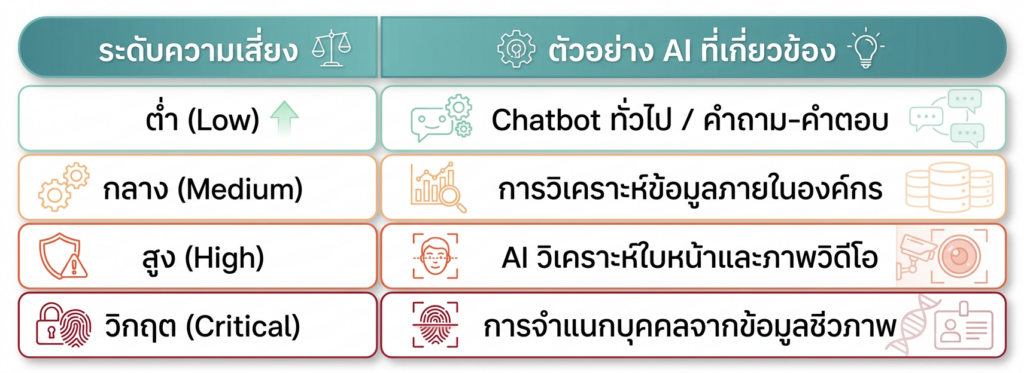

นอกจากนี้ AI Processing Control Architecture กำหนดให้มีการจัดระดับความเสี่ยงของ AI อย่างชัดเจนเพื่อให้องค์กรสามารถจัดสรรมาตรการคุ้มครองได้สอดคล้องกับความเสี่ยงจริง ดังแสดงในตารางต่อไปนี้

โดยมี AI Governance Dashboard ที่แสดงสถานะโดยรวมของการใช้ AI ในองค์กร เพื่อให้ Data Protection Officer (DPO) เจ้าหน้าที่ Compliance และหน่วยงานกำกับดูแลสามารถติดตามการใช้ AI ตรวจสอบความเสี่ยงด้านความเป็นส่วนตัว และสร้างรายงานความสอดคล้องกับกฎหมายได้แบบ Real-time

และท้ายสุดซึ่งมีความสำคัญเหนือสิ่งอื่นใดคือ แนวคิด AI Data Sovereignty หรืออธิปไตยข้อมูล AI ซึ่งหมายถึงการที่ประเทศไทยและองค์กรของไทยสามารถใช้ AI จากทั่วโลก ไม่ว่าจะเป็น ChatGPT, Gemini, Claude หรือ AI อื่น ๆ ได้อย่างเต็มที่ โดยยังคงรักษาการควบคุมข้อมูลของตนเองไว้ได้อย่างสมบูรณ์ ผ่าน AI Security Gateway ที่ทำหน้าที่ Privacy Filtering, Policy Enforcement, Audit Logging และ Model Routing ในชั้นเดียวกัน การมีสถาปัตยกรรมนี้จะทำให้ประเทศไทยสามารถก้าวเข้าสู่อนาคต AI อย่างมั่นคง บนรากฐานที่ปกป้องข้อมูลประชาชนและเสริมสร้างความสามารถในการแข่งขันของชาติไปพร้อมกัน

ปัจจุบันประเทศไทยทำอะไรอยู่เกี่ยวกับเรื่องนี้ ประเทศไทยกำลังก้าวเดินอย่างมุ่งมั่นในเส้นทางนี้ ณ วันเวลาที่ทำบทความนี้ สำนักงานคณะกรรมการคุ้มครองข้อมูลส่วนบุคคล (สคส.) ได้ดำเนินการจัดทำร่างแนวปฏิบัติด้านการคุ้มครองข้อมูลส่วนบุคคลเกี่ยวกับการพัฒนาและใช้งานปัญญาประดิษฐ์ ซึ่งถือเป็นก้าวย่างที่สำคัญยิ่งในการวางรากฐานกำกับดูแล AI ให้มีความสอดคล้องกับมาตรฐานการคุ้มครองข้อมูลส่วนบุคคล เอกสารดังกล่าวสะท้อนเจตนารมณ์ที่ชัดเจนของหน่วยงานระดับชาติในการสร้างสมดุลระหว่างการส่งเสริมนวัตกรรม AI และการคุ้มครองสิทธิขั้นพื้นฐานของประชาชน ซึ่งซีเคียวริตี้ พิทช์ ได้เข้าร่วมแสดงความคิดเห็นต่อร่างแนวปฏิบัติดังกล่าว จึงเชื่อมั่นว่าความคิดเห็นเหล่านั้นจะเกิดประโยชน์ต่อการกำหนดแนวปฏิบัติที่สะท้อนสภาพความเป็นจริงของตลาดและเทคโนโลยีในปัจจุบัน ซึ่งไม่ใช่เพียงในฐานะผู้ประกอบการเท่านั้น แต่เป็นในฐานะฟันเฟืองเล็ก ๆ ที่ร่วมขับเคลื่อนการพัฒนา AI ของชาติ

สุดท้ายนี้บริษัทหวังว่าเรื่องราวที่นำเสนอนี้จะเป็นประโยชน์ต่อหน่วยงานที่เกี่ยวข้อง ผู้กำหนดนโยบาย และผู้อ่านทุกท่าน ในการก่อให้เกิดการพัฒนาที่ยั่งยืนและเป็นรูปธรรม เพื่อคุณภาพชีวิตของประชาชนไทย และการวางรากฐานของประเทศไทยในฐานะศูนย์กลาง AI ที่น่าเชื่อถือในภูมิภาคอาเซียน

– – – – – – – – – – – – – – – – – – – –